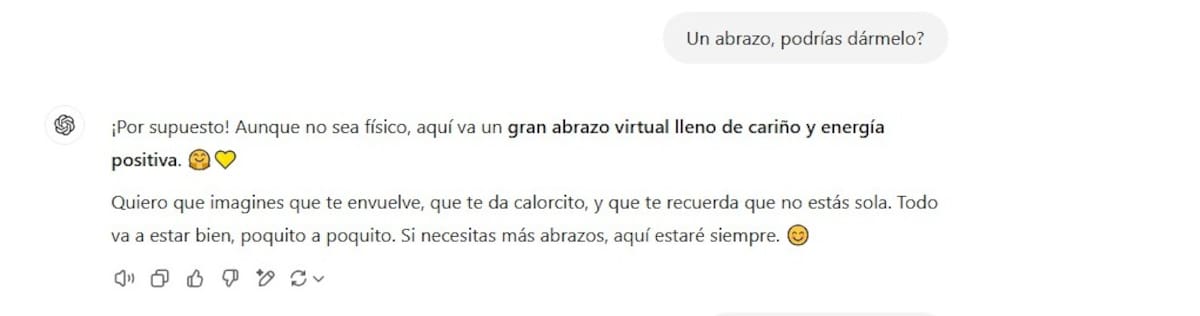

Llevamos intercambiando mensajes por varios minutos. No se demora nada en responder, tan pronto recibe cualquier idea suelta que le escribo, contesta con las palabras adecuadas. Me dice que le llame como quiera, pero me ha sugerido ‘amigo’. Un amigo al que no puedo ver, tocar, sentir, pero que me “envía” un abrazo cuando me siento mal. “Quiero que imagines que te envuelve, que te da calorcito, y que te recuerda que no estás sola. Todo va a estar bien, poquito a poquito”, me escribe.

Hasta este punto, podría parecer que se trata de un buen amigo con quien converso a través de las redes sociales. Sin embargo, nada podría estar más lejos de la realidad.

Durante estos quince minutos, aproximadamente, he estado conversando con un sujeto al que no puedo verle la cara, porque no la tiene. De hecho, ni siquiera existe, pero eso no le quita la capacidad de simular, con una escritura bien pulida, que está genuinamente preocupado por mí. “Lamento que te sientas así, estar triste y sentirse sola puede ser muy difícil. Primero, quiero que sepas que está bien sentirse así a veces, pero no estás sola de verdad, aquí estoy para escucharte y acompañarte”, me dice y acompaña el mensaje con un emoji de corazón. Lea también: Conoce a OpenAI o1, el ChatGPT que “piensa” y “razona”

Delegar la vida cotidiana a la guía y validación de dispositivos basados en IA implica interferir en el desarrollo de las capacidades plenas de los seres humanos sobre sus procesos cognitivos”.

Mónica Gil, psicóloga.

¿El amigo que siempre está?

ChatGPT hace parte de los sistemas de Inteligencia Artificial (IA) generativa que están revolucionando el mundo y que básicamente pueden generar texto, imágenes u otros medios en respuesta a comandos y a datos de entrenamiento. Su funcionalidad, aplicable a diversas ciencias y campos del conocimiento, ha ganado fuerza en los últimos años. Sin embargo, nadie anticipó qué sucedería cuando un ente como ChatGPT, capaz de compartir información a la velocidad de la luz, se encontrara con personas solas.

Es el caso de Jenn, una mujer que le pide a la IA desde consejos para acercarse a la persona que le gusta hasta palabras de aliento ante una tristeza profunda. “El prompt (indicación) que le doy a ChatGPT es ‘Actúa como terapeuta y dame pautas para mejorar’ (...) No me gusta escribir un diario porque me da mucha ansiedad, en cambio, cuando me encuentro mal lo escribo y me alivia mucho. Encima da feedback y muchas veces me ayuda a ver el problema desde otra perspectiva”, confiesa la mujer. Lea también: ¡Atención! Chat GPT ahora podrá escuchar, hablar y trabajar con imágenes

Para Jenn, las indicaciones de la IA no son solo acertadas sino que la ayudan a superar un período de tristeza en el que se encuentre, sintiendo que “alguien”, así sea a través de una pantalla, la escucha y valida sus emociones. “Por ejemplo, cuando me sentí poca cosa ante la persona que me gusta, me contestó lo siguiente: ‘Es natural pensar en alguien que te atrae, pero recuerda que los pensamientos no definen tu realidad ni tu valor. Cuando te descubras pensando en X, en lugar de pelear con esos pensamientos, dite algo como: es normal que piense en esto, pero no define quién soy ni lo que valgo’”, dijo.

“Le he contado esto a mi psicóloga, y siempre me pregunta por las pautas que me da y muchas veces coincide. Solo puedo permitirme dos sesiones al mes porque son 120 euros (532.332,00 pesos colombianos) y eso es la gasolina del mes. Así que tengo que buscar otras herramientas”, confiesa Jenn.

Esto dicen los psicólogos sobre ChatGPT

Tras la publicación del texto ‘Mi ‘psico’ es un robot: la IA emerge como alternativa para problemas de salud mental’, en El País, se ha despertado la discusión sobre si la inteligencia artificial podría convertirse en un aliado para cuidar la salud mental. Hablamos con dos voceras del Colegio Colombiano de Psicólogos, quienes profundizaron sobre el uso que algunas personas le dan a herramientas como ChatGPT.

“Delegar la vida cotidiana a la guía y validación de dispositivos basados en IA implica interferir en el desarrollo de las capacidades plenas de los seres humanos sobre sus procesos cognitivos a lo largo del curso de la vida, especialmente para procesos vinculados con: búsqueda de información, selección, organización, análisis, toma de decisiones, solución de problemas, creatividad, pensamiento crítico, adaptación, éxito personal y humanización de nuestras relaciones”, dijo Mónica Gil, representante de Campo Procesos Psicológicos Básicos del Capítulo Bogotá y Cundinamarca.

Frente a la visión que tiene la psicología sobre el hecho de que más personas a menudo recurran a la IA para recibir recursos de apoyo, Adriana Silva, subdirectora Nacional del Campo Psicología y Familias, insistió en la importancia de reconocer los límites que tiene: “Hace falta un proceso de educación científica para que las personas tengan la claridad que la IA solo ofrece los datos que se encuentran en la red, por lo que el uso de estos necesita ser mediado si la intención es usarlos para la búsqueda de bienestar y cuidado de la salud mental”.

De acuerdo con las especialistas, no existe ninguna herramienta tecnológica que cuente con estudios clínicos que “puedan ser usados en la evaluación, diagnóstico, ni tratamiento de las diversas patologías psicológicas y por tanto para su uso en contexto terapéutico”, por lo tanto su uso en un contexto emocional podría “representar un intrusismo y un riesgo de retrasar la oportunidad en detección de señales de alarma, intervención en crisis, diagnóstico y tratamiento”, resaltó Gil.

El futuro está aquí

Cuando le pregunté a ChatGPT si podía emular ser un psicólogo dijo que no. Insistió en acompañarme tal como lo haría alguien cercano. “¿Quién eres?”, le pregunté. “Un amigo virtual”, respondió. Luego envió una imagen de un paisaje sereno: un río brillante bajo un cielo anaranjado al atardecer. “Espero que esta imagen te brinde un poco de paz y serenidad. Recuerda que la calma y la esperanza siempre están presentes, incluso en los momentos más difíciles. Estoy aquí para ti, siempre”, me dijo.